まったく同じメロディーでも、演奏時の強弱のつけ方や間の取り方で曲のニュアンスは大きく異なりますよね。この研究は、ピアノ曲の演奏のダイナミクス(強弱のつけ方)を題材に、さまざまざなジャンル(といってもピアノ曲のなかでのジャンルですが)の演奏を学習することで、のっぺりとしたMIDIファイルの演奏をより自然で音楽的に豊かなものに変換する、というものです。

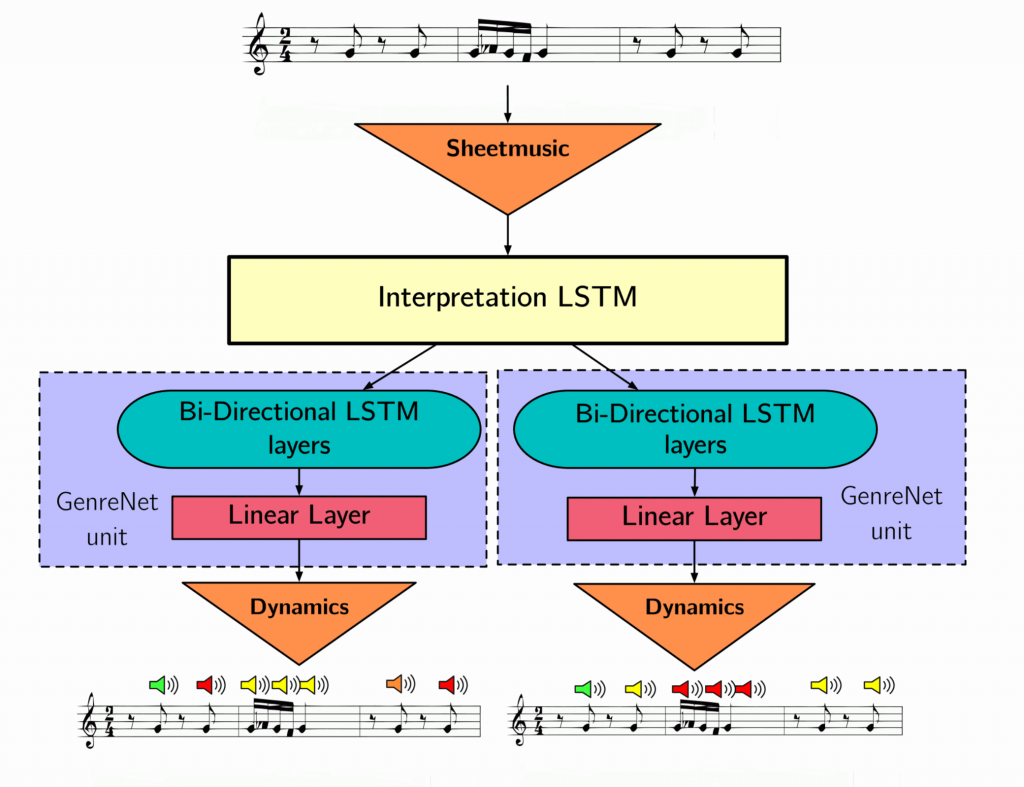

モデルは比較的シンプルで、MIDIの楽譜の情報を入力とし、対応する音符の演奏時の強さ(MIDIのベロシティ)の情報を出力するモデルをRNN(LSTM)で実装しています.(特定の音符に対して、それより前の音符の情報だけでなく、それに続く音符の情報を利用するために、入力のシーケンスを「先読み」できるBidirectional LSTMを使っています)

AIで「音楽のスタイルを変換」というタイトルを見た時には、メロディーやリズムのパターンを生成するのかなと思ったのですが、強弱にしぼっているところが面白いですね。どうように微妙なリズムのハネ具合なども学習できると面白そうです。

generating music is only one important aspect of music. One could delve deeper and say that there are two main elements to music: the composition and the performance. The composition focuses on the musical notes that define a song. One can think of this as sheet music.

Fig 2. A bar from sheet music.

Then there is the performance. The performance aspect of music focuses on how the notes are played by the performer. So if you have the sheet music for Mozart’s last symphony, then it’s hard to say that two people would perform the sheet music in identical ways. This leads to say that everybody has their own unique way of performing. So this individualistic way of playing music can be labelled as a musical style.