人の写真を一枚撮ってあげると、自動的にその人の髪型を推定し、その3Dモデルを生成するという、耳を疑うような研究です。

著者のMenglei Chaiさんは、頭髪の複雑な構造をどうやれば簡単にモデリングすることができるのか、ということについて長年研究されている方です。

この研究のすごいところは、ユーザーが細かいパラメーター調整をすることなく、顔の正面画像を一枚入力するだけで、完全な3Dモデルを推定してくれる、というところらしいです。

Automatic Hair Modeling from One Image | Two Minute Papers

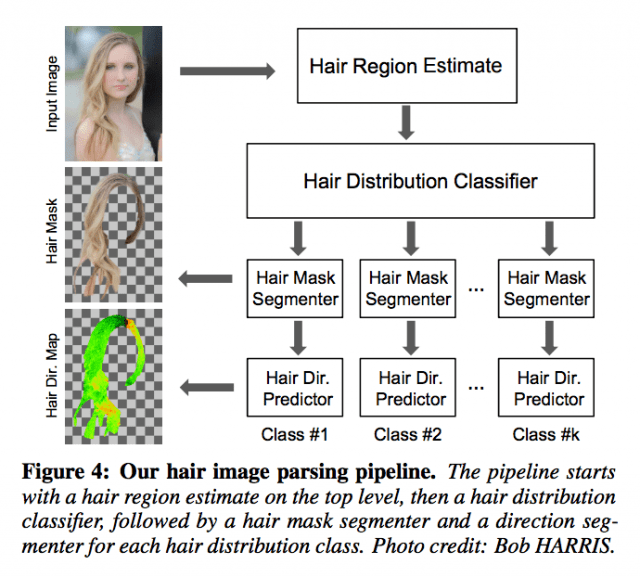

まずは下の画像のように、入力画像の領域分割を行って頭髪の抽出を行い、髪のdirection map(髪の毛がどちらの方向に向いているのかをを量子化したもの)を生成します。領域分割にはR-CNN[Girshick et al. 2014]を使い、領域のラベル分けにはVGG16ベースのCNNを使っているらしいです。

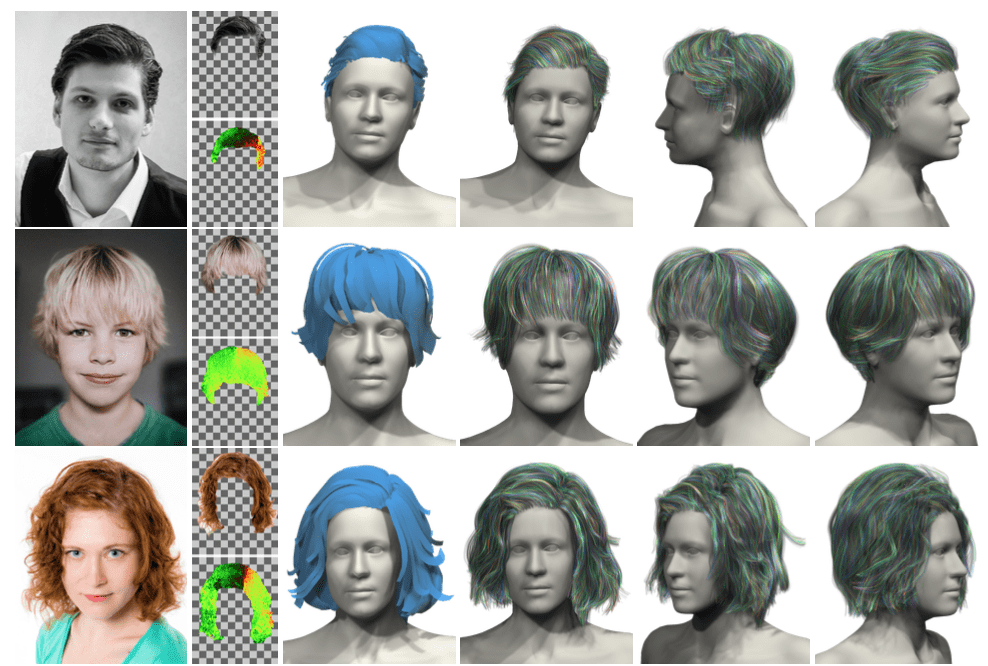

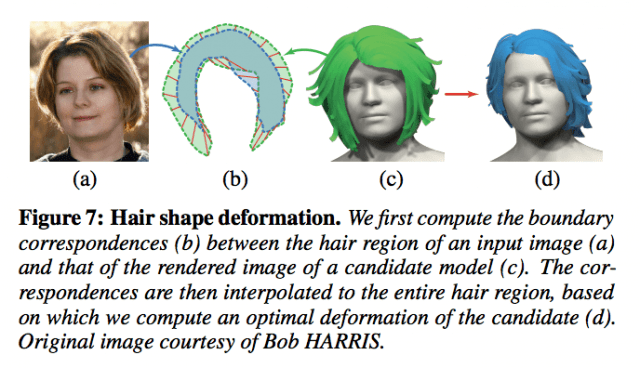

次に、あらかじめ集めておいた300個の部分的な頭髪の3Dモデルを組み合わせていろんな髪型のモデルを作り、入力画像の、頭髪のマスクと髪のdirection mapと比べて最も近いモデルを選択します。さらに、下の画像のようにマスクに合うように3Dモデルの各頂点を最適化して、3Dモデルを生成します。後は、最初に生成した髪の方向性を量子化したdirection mapを使って、細かい質感を整えると完成・・・らしいです。(最後の毛先の質感を出す技術は、下の論文がソースらしいです。)

2015, Menglei Chai et al. : High-Quality Hair Modeling from A Single Portrait Photo

一から3Dモデルを生成しようとはせずに、R-CNNなどの深層学習の技術や、マスクやdirection mapをうまく使って、髪型のデータベースにおけるマッチング問題に持って行ったところがポイントなのでしょうか。入力してからモデルを生成するのにかかる時間は1分弱らしく、高速で動くのも魅力ですね。

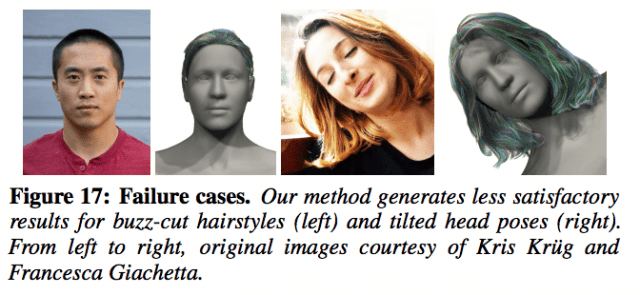

ちなみに、坊主カットや、頭が傾いている写真を入力すると、失敗するみたいです。(笑)

ACM.SIGGRAPH ’16(2016.07.24公開)We introduce AutoHair, the first fully automatic method for 3D hair modeling from a single portrait image, with no user interaction or parameter tuning. Our method efficiently generates complete and high-quality hair geometries, which are comparable to those generated by the state-of-the-art methods, where user interaction is required. The core components of our method are: a novel hierarchical deep neural network for automatic hair segmentation and hair growth direction estimation, trained over an annotated hair image database; and an efficient and automatic data driven hair matching and modeling algorithm, based on a large set of 3D hair exemplars. We demonstrate the efficacy and robustness of our method on Internet photos, resulting in a database of around 50K 3D hair models and a corresponding hairstyle space that covers a wide variety of real-world hairstyles. We also show novel applications enabled by our method, including 3D hairstyle space navigation and hair-aware image retrieval.